الرئيسية

أخبارعاجلة

رياضة

- الأخبار الرياضية

- أخبار الرياضة

- فيديو أخبار الرياضة

- نجوم الملاعب

- أخبار الرياضة

- ملاعب عربية وعالمية

- بطولات

- أخبار الأندية العربية

- مقابلات

- رياضة عربية

- رياضة عالمية

- موجب

- سالب

- مباريات ونتائج

- كرة الطائرة

- كرة اليد

- كرة السلة

- رمي

- قفز

- الجري

- تنس

- سيارات

- غولف

- سباق الخيل

- مصارعة

- جمباز

- أخبار المنتخبات

- تحقيقات

- مدونات

- أخبار المحترفين

- غاليري

ثقافة

إقتصاد

فن وموسيقى

أزياء

صحة وتغذية

سياحة وسفر

ديكور

رئيس غوغل السابق يحذر من اختراق الذكاء الاصطناعي وتحوله إلى سلاح خطير

شركة التكنولوجيا الأميركية غوغل

واشنطن -العرب اليوم

دق إريك شميت، الرئيس التنفيذي السابق لشركة «غوغل»، ناقوس الخطر، مُحذّراً من إمكانية اختراق أنظمة الذكاء الاصطناعي وإعادة تدريبها لتصبح أسلحة خطيرة للغاية.

وفي حديثه خلال مؤتمر Sifted Summit 2025 في لندن، أوضح شميت أنه يمكن إزالة ضوابط الأمان من النماذج المتقدمة للذكاء الاصطناعي.

وقال: «هناك أدلة على إمكانية استخدام النماذج، مغلقة كانت أم مفتوحة، واختراقها لإزالة حواجزها الواقية».

وأضاف: «خلال عملية تدريبها، تتعلم النماذج الكثير من الأشياء. ومن الأمثلة السيئة على ذلك، أنها قد تتعلم كيفية قتل شخص ما».

وأشاد شميت بشركات الذكاء الاصطناعي الكبرى لحجبها للمطالبات الخطيرة، قائلاً: «جميع الشركات الكبرى تجعل من المستحيل على النماذج الإجابة عن مثل هذه الأسئلة والمطالبات الخطيرة. إنه قرار صائب».

لكنه حذّر من أنه حتى الدفاعات القوية يمكن عكسها.

وأضاف: «هناك أدلة على إمكانية هندستها عكسياً»، مشيراً إلى أن المتسللين قد يستغلون هذا الضعف.

وشبّه شميت سباق الذكاء الاصطناعي اليوم بالعصر النووي المبكر، قائلا إن هذه التقنية قوية لكنها ذات ضوابط عالمية محدودة. وحثّ قائلاً: «نحن بحاجة إلى نظام حظر انتشار، حتى لا يتمكن المخربون من إساءة استخدام هذه الأنظمة».

ولفت شميت إلى أن قلقه ليس نظرياً. ففي عام 2023، ظهرت نسخة معدلة من «تشات جي بي تي» تُسمى DAN، وهي اختصار لعبارة «افعل أي شيء الآن Do Anything Now»، على الإنترنت. وتجاوز هذا الروبوت «المخترق» قواعد السلامة وأجاب عن أي طلب تقريباً. وكان المستخدمون «يهددونه» بالموت الرقمي إذا رفض، وهو دليل غريب على مدى هشاشة أخلاقيات الذكاء الاصطناعي بمجرد التلاعب بشفرته.

وحذّر شميت من أنه دون تطبيق صارم، قد تنتشر هذه النماذج المارقة دون رادع، وقد تُستخدم لإلحاق الضرر من قِبل جهات فاعلة.

وكان الرئيس التنفيذي السابق لـ«غوغل» قد عبر عن قلقه في فبراير (شباط) الماضي من أن يستخدم الإرهابيون أو «الدول المارقة» الذكاء الاصطناعي «لإيذاء الأبرياء».

وقال لشبكة «بي بي سي» البريطانية: «المخاوف الحقيقية التي لدي ليست تلك التي يتحدث عنها معظم الناس بشأن الذكاء الاصطناعي، أنا أتحدث عن المخاطر الشديدة».

وأضاف شميت أن «كوريا الشمالية، أو إيران، أو حتى روسيا، يمكن أن تتبنى وتسيء استخدام هذه التكنولوجيا، فهي سريعة بما يكفي بحيث يمكنهم إساءة استخدامها وإحداث ضرر حقيقي بفضلها».

ودعا إلى فرض رقابة حكومية على شركات التكنولوجيا الخاصة التي تعمل على تطوير نماذج الذكاء الاصطناعي، لكنه حذّر من أن الإفراط في التنظيم قد يخنق الابتكار، مؤكداً أهمية وجود توازن بين الأمرين.

قد يهمك أيضــــــــــــــا

جوجل تُحدث ثورة تعليمية بـ 30 أداة ذكاء اصطناعى جديدة

الذكاء الاصطناعي يهدد 44 وظيفة من بينها الترجمة والكتابة وخدمة العملاء

GMT 13:17 2026 الأربعاء ,29 إبريل / نيسان

شركات التكنولوجيا الصينية تتسابق لاقتناص رقائق هواوي وسط منافسة متصاعدةGMT 18:49 2026 الثلاثاء ,21 إبريل / نيسان

مركبة ناسا المتنقلة تكتشف مزيدا من لبنات الحياة على المريخGMT 23:09 2026 الأربعاء ,15 إبريل / نيسان

الحياة على المريخ قد تغير شكل البشر ليصبحوا أطول قامة وأضعف عظاماGMT 04:44 2026 السبت ,11 إبريل / نيسان

ماسك يحذر من واتساب ومؤسس تليغرام يدخل على الخطGMT 02:09 2026 الإثنين ,30 آذار/ مارس

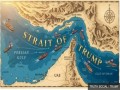

رواد ناسا يقتربون من أول مهمة مأهولة إلى القمر منذ عقودالإدارة الأميركية تبحث آليات تنفيذ مشروع الحرية في مضيق هرمز

واشنطن ـ العرب اليوم

نقاشات داخل الإدارة الأمريكية تتركز حول كيفية تطبيق مشروع الحرية الذي أعلن عنه الرئيس ترامب، والذي يقضي بمساعدة السفن الحربية الأمريكية في فك الحصار عن السفن العالقة في مضيق هرمز وإنقاذ آلاف البحارة، موضحًا أن ال�...المزيدهاني شاكر أمير الغناء العربي سيرة فنية حافلة وأعمال خالدة

القاهرة - العرب اليوم

هاني شاكر اسم لمع في عالم الغناء العربي هاني شاكر هو مطرب وممثل مصري بارز، يُلقب بـ"أمير الغناء العربي". يُعتبر من عمالقة الفن في الجيل الحديث، وحقق شهرة واسعة بصوته الرومانسي. شغل منصب نقيب الموسيقيين في مصر، �...المزيدماسك يتهم أوبن إيه آي باستغلال العمل الخيري لتحقيق أرباح تجارية

واشنطن - العرب اليوم

بعد أسبوع من بدء محاكمة إيلون ماسك ضد سام ألتمان، التي تجمع بين قطبين في عالم التكنولوجيا في قضية قد يكون لها تداعيات كبيرة على شركة أوبن إيه آي، أوضح المدعي رسالته الأساسية لهيئة المحلفين. قال ماسك، أغنى شخص في الع...المزيدفتح باب الترشح لـ"جائزة الشيخ زايد للكتاب" في دورتها الـ21

أبوظبي ـ العرب اليوم

أعلنت جائزة الشيخ زايد للكتاب، التي ينظمها مركز أبوظبي للغة العربية التابع لدائرة الثقافة والسياحة – أبوظبي، الجمعة، فتح باب الترشح لدورتها الـ21 (2026–2027)، اعتباراً من الأول من مايو وحتى الأول من سبتمبر المقبل....المزيد Maintained and developed by Arabs Today Group SAL

جميع الحقوق محفوظة لمجموعة العرب اليوم الاعلامية 2025 ©

Maintained and developed by Arabs Today Group SAL

جميع الحقوق محفوظة لمجموعة العرب اليوم الاعلامية 2025 ©

أرسل تعليقك